💥 E se eu te dissesse que o médico errou… mas não foi culpa dele?

Essa frase incomoda porque confronta uma das narrativas mais convenientes da saúde: a de que, diante de um evento adverso, basta encontrar um culpado, dar um nome ao erro, registrar a ocorrência, reforçar um protocolo e seguir em frente. É uma narrativa sedutora. Simples. Linear. E profundamente enganosa.

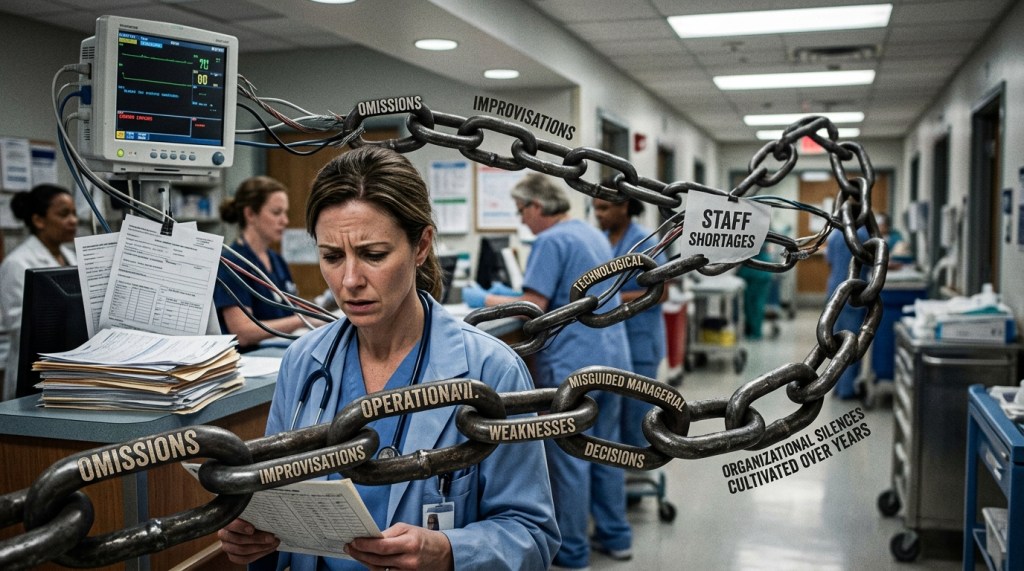

💥 A verdade é mais desconfortável: muitos dos chamados “erros médicos” são, na prática, falhas sistêmicas com manifestação humana. O profissional aparece na ponta visível do evento, mas o problema quase nunca nasce ali. Ele é apenas o último elo de uma cadeia de omissões, improvisações, ruídos operacionais, fragilidades tecnológicas, decisões gerenciais equivocadas e silêncios organizacionais cultivados por anos.

Quando um hospital escolhe tratar o erro como desvio individual e não como produto previsível de um sistema mal desenhado, ele não corrige a causa. Ele apenas preserva a ilusão de controle. E essa ilusão custa caro: custa confiança, custa reputação, custa engajamento das equipes, custa eficiência operacional e, em casos mais graves, custa vidas.

⚠️ Erro médico é muitas vezes um sintoma, não a doença.

Este artigo não pretende absolver condutas imprudentes nem negar a responsabilidade profissional. O ponto é outro, e muito mais sério: há uma diferença estratégica entre responsabilizar e simplificar. Hospitais maduros responsabilizam com método, evidência e visão sistêmica. Hospitais frágeis simplificam. E, ao simplificar, repetem o erro.

Hoje, o maior risco não é apenas o profissional cansado, o plantão tenso ou a decisão tomada em segundos. O maior risco é a organização que ainda acredita que segurança do paciente se resolve com cartaz na parede, treinamento pontual e busca por culpados.

Vamos desmontar essa crença, camada por camada.

1. O caso que todos diriam ser “erro médico”

🩺 Era pouco depois das 19h. A transição entre turnos começava a produzir aquele tipo de ruído que nenhum relatório estratégico consegue traduzir com precisão: múltiplas demandas simultâneas, pendências acumuladas, profissionais terminando tarefas do turno anterior enquanto os do próximo ainda tentavam entender o panorama do setor.

No pronto atendimento pediátrico, a lotação já havia ultrapassado o nível considerado confortável. Havia crianças em observação além da capacidade originalmente planejada, uma equipe de enfermagem operando no limite, um residente tentando dar vazão às reavaliações e uma médica plantonista que, nas últimas quatro horas, praticamente não havia se sentado.

👀 Entre tantas fichas, uma chamava atenção sem parecer, à primeira vista, extraordinária. Uma criança de 6 anos, com quadro infeccioso, vômitos, febre persistente e desidratação moderada. O paciente havia sido transferido de outra área interna para continuidade do manejo. A prescrição previa antibiótico venoso, hidratação, controle sintomático e reavaliação clínica.

O antibiótico foi administrado.

Pouco tempo depois, a criança apresentou reação importante. Houve mobilização rápida da equipe. Intervenção. Suporte. Estabilização. Investigação imediata.

Então veio a descoberta que congelou o ambiente: o medicamento administrado era contraindicado para aquele paciente por histórico prévio de reação adversa relevante registrado em atendimento anterior.

Silêncio.

Depois, tensão.

Em seguida, a pergunta que emerge quase sempre antes de qualquer análise madura:

Quem foi o responsável?

🧾 A auditoria preliminar indicou o caminho aparentemente óbvio. A médica havia validado a prescrição. A enfermagem havia administrado. Havia registro da medicação no sistema. Havia assinatura. Havia horário. Havia rastreabilidade suficiente para individualizar o ato.

E, como costuma acontecer em organizações que ainda tratam eventos adversos como exceções morais e não como fenômenos sistêmicos, a história começou a ser contada assim:

“A médica errou.”

“A enfermagem não percebeu.”

“Faltou atenção.”

“Faltou checagem.”

A narrativa parecia pronta. O caso já tinha rosto. Já tinha responsáveis. Já tinha, inclusive, uma utilidade política: demonstrar reação institucional rápida.

Mas o que parecia um erro individual começaria, pouco a pouco, a revelar outra coisa.

2. A primeira camada: o erro humano, como o sistema gosta de enxergar

⚖️ O erro humano é a camada mais visível porque é a mais fácil de localizar. Ela oferece nomes, horários, ações e registros. Ela transforma complexidade em narrativa palatável. E, sobretudo, ela protege o sistema de uma pergunta muito mais perigosa:

Como foi possível que isso acontecesse?

Na leitura tradicional, o caso era simples. A médica deveria ter visto a informação. A enfermagem deveria ter checado a contraindicação. Alguém falhou. E, portanto, o problema estava resolvido conceitualmente: bastaria advertir, reorientar, treinar e reforçar o protocolo.

📌 Esse tipo de raciocínio é tentador porque organiza o caos em torno de uma figura central: o profissional na ponta. Mas ele produz um efeito colateral devastador. Ao reduzir o evento ao comportamento individual, a organização deixa intacto tudo aquilo que tornou o erro provável.

É o equivalente corporativo a culpar o operador por um acidente em uma linha de produção desenhada sem barreiras, sem sensores, sem redundância e sem manutenção preventiva. A pessoa toca o botão errado. Sim. Mas o desenho inteiro já estava convidando o erro a acontecer.

Na saúde, isso é ainda mais grave porque o trabalho assistencial é realizado sob:

- alta carga cognitiva;

- necessidade constante de priorização;

- múltiplos fluxos paralelos;

- comunicação interprofissional intensa;

- pressão temporal;

- variabilidade clínica;

- dependência de informação confiável no momento certo.

📉 Quando se exige desempenho perfeito em sistemas imperfeitos, o resultado não é excelência. O resultado é previsibilidade do erro.

A questão central não é se profissionais erram. Claro que erram. A questão é: o sistema em que trabalham foi desenhado para reduzir a probabilidade do erro ou para amplificá-la?

Essa distinção separa instituições maduras de instituições apenas ocupadas.

⚠️ Sistemas ruins produzem erros previsíveis.

E, se o erro era previsível, então ele não pertence apenas à pessoa que o executou. Ele pertence ao arranjo inteiro que o permitiu.

3. A segunda camada: o contexto operacional que ninguém quer discutir com profundidade

🏥 Quando a análise avançou além da prescrição e da administração, o caso começou a ganhar contornos mais incômodos.

A transferência do paciente entre áreas ocorreu em um horário de alta sobrecarga. O handoff clínico foi parcialmente verbal, parcialmente registrado, com lacunas de padronização. A informação sobre o histórico anterior de reação adversa estava disponível, mas distribuída em pontos distintos do ecossistema informacional. Parte constava em evolução antiga. Parte em anotação de enfermagem. Parte havia sido mencionada em atendimento anterior sem o devido destaque semântico para reutilização futura.

Nada disso parece dramático isoladamente. Mas segurança do paciente raramente colapsa por uma falha cinematográfica. Ela se deteriora por acúmulo de pequenas fragilidades normalizadas.

O que o contexto revelou

🔹 Havia sobrecarga assistencial real

A equipe trabalhava acima da capacidade operacional segura. Não era sensação. Era condição objetiva. O número de pacientes por profissional havia se distanciado do cenário ideal, e isso reduzia tempo de análise, capacidade de dupla checagem e margem cognitiva para perceber inconsistências.

🔹 A comunicação era fragmentada

O processo de transição entre setores dependia excessivamente de comunicação verbal e da memória operacional dos profissionais. Em ambientes de alta rotatividade e pressão assistencial, isso é um risco estrutural.

🔹 Não existia padronização robusta de handoff

Sem método claro para transferência de informações críticas, a qualidade da passagem de caso variava conforme experiência, perfil individual e contexto do turno.

🔹 As prioridades eram concorrentes

Ao mesmo tempo em que a equipe precisava revisar prescrições, lidar com familiares, responder intercorrências e manter fluxo assistencial, o sistema exigia precisão absoluta sem oferecer suporte proporcional.

🔹 O desvio já estava normalizado

A operação convivia com improvisações diárias consideradas “normais”. E o que é normalizado deixa de ser percebido como risco.

📌 Esse é um ponto central para executivos hospitalares: muitos eventos adversos não nascem de uma quebra abrupta do processo, mas da institucionalização silenciosa do processo ruim.

A organização se acostuma a operar no limite. O atalho vira rotina. A exceção vira prática. O improviso vira competência informal. E o hospital começa a funcionar por heroísmo humano em vez de desenho operacional robusto.

Isso é perigosíssimo.

Porque o heroísmo é admirável, mas não escala.

E o improviso resolve o plantão, não o sistema.

⚠️ Não existe segurança do paciente sem arquitetura de processos.

4. A terceira camada: a infraestrutura invisível que fabrica vulnerabilidade

💻 Quando a tecnologia entra na conversa, muitos hospitais ainda a tratam como acessório, não como componente estrutural da segurança. Esse é um erro estratégico grave.

No caso descrito, o histórico de reação adversa existia no prontuário. Mas não existia do jeito certo, no lugar certo, com a inteligência certa, no momento certo.

E isso muda tudo.

O que foi encontrado na camada tecnológica

🔸 Sistemas não integrados plenamente

Informações clínicas relevantes estavam dispersas entre módulos, telas e registros históricos de difícil recuperação contextual.

🔸 Prontuário com baixa usabilidade clínica

A informação existia, mas a experiência de acesso era ruim. Exigir que o profissional procure manualmente dados críticos em ambiente de pressão é transferir para a ponta uma responsabilidade que deveria ser compartilhada com a arquitetura digital.

🔸 Ausência de alertas inteligentes de alto valor

O sistema não bloqueava nem sinalizava com força suficiente a incompatibilidade entre histórico do paciente e medicação prescrita. Em outras palavras: o hospital confiava mais na memória e atenção humana do que em barreiras tecnológicas.

🔸 Dependência de registros paralelos

Parte do conhecimento operacional relevante circulava em planilhas, papéis, anotações informais ou comunicação oral. Toda vez que a instituição admite “controles paralelos”, ela está confessando que seu sistema oficial não atende plenamente à operação.

🔸 Baixa maturidade de governança sobre dados críticos

Não bastava registrar alergias e reações. Era necessário classificá-las, destacá-las, mantê-las consistentes, interoperáveis e acionáveis.

🧠 Aqui está uma verdade que muitos boards ainda evitam encarar: dado não estruturado, mal posicionado ou invisível no fluxo de trabalho equivale, na prática, a dado inexistente.

O hospital pode até alegar: “mas a informação estava lá”.

Sim, estava.

Mas segurança não depende apenas de existência documental. Segurança depende de disponibilidade decisória.

Essa é a diferença entre armazenar informação e transformar informação em proteção.

A infraestrutura invisível é decisiva

🔍 Em hospitais, a infraestrutura invisível inclui:

- prontuário eletrônico e sua usabilidade real;

- integração entre sistemas clínicos, assistenciais e administrativos;

- mecanismos de alerta e suporte à decisão;

- governança sobre dados mestres do paciente;

- desenho do fluxo informacional entre setores;

- qualidade semântica dos registros;

- eliminação de redundâncias confusas;

- visibilidade de eventos críticos no ponto assistencial.

Quando essa infraestrutura falha, o profissional opera em névoa.

E, num ambiente clínico, névoa informacional é risco operacional.

⚠️ O problema não é apenas ter tecnologia. O problema é ter tecnologia que não protege.

5. A quarta camada: a cultura organizacional que escolhe punir em vez de aprender

🧩 Depois do evento, o comportamento institucional disse tanto quanto o próprio caso.

As conversas de bastidor começaram rápido. A busca por nomes ganhou velocidade maior que a busca por causas. Houve preocupação com repercussão, com percepção da família, com documentação defensiva, com a necessidade de mostrar controle.

Tudo isso é compreensível. Mas também é revelador.

Organizações com cultura frágil tratam eventos adversos como ameaça reputacional antes de tratá-los como oportunidade de aprendizagem sistêmica. E isso contamina toda a resposta institucional.

Os sinais clássicos de cultura punitiva

🔹 O profissional evita relatar quase-erros por medo de exposição.

🔹 A notificação vira mecanismo de vigilância, não de melhoria.

🔹 O debriefing é superficial e juridicamente defensivo.

🔹 O foco recai na falha ativa, não nas condições latentes.

🔹 Lideranças confundem firmeza com culpabilização.

🔹 O aprendizado coletivo não acontece porque a análise real nunca aprofunda.

📌 Em uma cultura punitiva, o erro reportado é apenas a ponta do iceberg. O que assusta de verdade são os erros não reportados, os desvios ocultos, os quase-erros normalizados e os riscos silenciosos que seguem vivos porque ninguém quer ser o próximo exposto.

A pergunta estratégica deixa de ser “por que erramos?” e passa a ser “por que as pessoas não se sentem seguras para mostrar onde o sistema vai errar de novo?”.

Cultura de segurança não é complacência

Há um equívoco recorrente nas lideranças: acreditar que abandonar a cultura punitiva é afrouxar responsabilidade. Não é.

Cultura de aprendizado não significa ausência de accountability. Significa accountability madura.

Ela diferencia:

- erro humano não intencional;

- comportamento de risco estimulado pelo contexto;

- negligência deliberada ou imprudência grave.

Sem essa diferenciação, tudo vira culpa.

E, quando tudo vira culpa, nada gera aprendizagem robusta.

🛑 O hospital que pune indiscriminadamente mata sua própria inteligência operacional. Porque as pessoas passam a esconder sinais, evitar transparência e proteger a si mesmas em vez de proteger o sistema.

Essa é uma perda brutal de capital institucional.

6. A quinta camada: a falha estratégica que antecede a falha assistencial

📊 Em algum momento, toda falha sistêmica relevante encontra sua origem em decisões estratégicas mal tomadas — ou não tomadas.

No caso do evento adverso, a pergunta madura não era apenas por que a médica prescreveu ou por que a enfermagem administrou. A pergunta mais importante era:

Por que o hospital ainda operava com processos, tecnologia e governança incapazes de impedir um erro já conhecido como possível?

A resposta, quase sempre, mora na estratégia.

Onde a falha estratégica costuma estar

1. TI tratada como custo

Quando tecnologia é vista apenas como despesa operacional, os investimentos se concentram em sustentação mínima, não em arquitetura de segurança, interoperabilidade e inteligência assistencial.

2. Transformação digital reduzida a informatização

Digitalizar formulário não é redesenhar processo. Colocar tela no lugar do papel não resolve fragmentação, baixa usabilidade, ausência de alertas ou decisões ruins baseadas em dados frágeis.

3. Governança de dados imatura

Sem regras claras de captura, qualidade, semântica, criticidade, interoperabilidade e uso dos dados, o hospital acumula informação sem gerar proteção real.

4. Segurança do paciente dissociada da agenda de tecnologia

Em muitas instituições, segurança é pauta assistencial, e tecnologia é pauta técnica. Isso é um erro de arquitetura de governança. Segurança clínica e maturidade digital precisam conversar no nível estratégico.

5. Liderança executiva sem visão sistêmica

Boards que não compreendem a relação entre processo, cultura, dados e tecnologia tendem a reagir a eventos em vez de construir resiliência organizacional.

📉 O resultado é previsível: o hospital investe em ilhas, não em ecossistema. Compra sistemas, mas não cria integração. Exige compliance, mas não simplifica o fluxo. Cobra indicadores, mas não garante qualidade do dado. Fala em inovação, mas tolera infraestrutura precária nos processos críticos.

Isso não é apenas ineficiência.

Isso é produção institucional de vulnerabilidade.

⚠️ Quando a estratégia é fraca, o risco clínico deixa de ser exceção e vira subproduto operacional.

7. O modelo sistêmico: traduzindo a teoria para linguagem executiva

📚 Para muitos líderes, conceitos de segurança parecem excessivamente acadêmicos. Mas eles são extremamente práticos quando traduzidos para a lógica de gestão.

O modelo do queijo suíço, de James Reason

Imagine várias fatias de queijo alinhadas. Cada fatia representa uma barreira de defesa do sistema:

- protocolo;

- treinamento;

- dupla checagem;

- prontuário;

- alerta eletrônico;

- padronização do handoff;

- supervisão clínica;

- cultura de notificação;

- governança.

Cada fatia tem buracos. Esses buracos são fragilidades normais: limitações humanas, falhas de processo, lacunas tecnológicas, variabilidade operacional.

O evento adverso ocorre quando os buracos se alinham.

O ponto mais importante para a liderança é este:

o problema não está em existir um buraco. O problema está em o sistema permitir o alinhamento deles.

Ou seja, o evento não é obra de um único erro. Ele é produto da falha simultânea de várias barreiras incompletas.

Falhas ativas vs falhas latentes

🔹 Falhas ativas são as ações visíveis na ponta: a prescrição inadequada, a administração indevida, a checagem que não ocorreu.

🔹 Falhas latentes são as condições invisíveis que ficaram incubadas no sistema: sobrecarga, sistema ruim, ausência de alertas, processo mal desenhado, cultura punitiva, liderança omissa.

As falhas ativas aparecem no incidente.

As falhas latentes já estavam lá antes — e continuam lá depois, se nada estrutural for feito.

Para o executivo, isso significa algo simples e duro:

quem corrige apenas a falha ativa está gerenciando sintomas.

Sistemas complexos adaptativos

Hospitais não são linhas de montagem lineares. São sistemas complexos adaptativos. Isso significa que:

- múltiplos agentes interagem ao mesmo tempo;

- pequenas variações podem gerar grandes impactos;

- o comportamento do sistema não é totalmente previsível;

- o contexto muda continuamente;

- a operação se adapta em tempo real.

Por isso, não adianta importar soluções simplistas de controle. Em sistemas complexos, segurança não nasce só de norma. Nasce de:

- desenho de processo;

- visibilidade de risco;

- capacidade de adaptação segura;

- feedback rápido;

- aprendizado institucional;

- tecnologia que apoia decisão em tempo real.

🧠 Traduzindo para o idioma do board: hospital seguro não é o que exige perfeição humana. É o que constrói redundâncias inteligentes para absorver imperfeições humanas sem colapsar.

8. O que esse caso nos obriga a admitir

🔍 A revelação progressiva do caso fictício leva a uma constatação incômoda: a culpa individual era apenas a forma mais superficial de explicar algo que, na verdade, nasceu de um ecossistema inteiro de fragilidade.

Quem errou?

A médica, em alguma medida, errou.

A enfermagem, em alguma medida, também não interrompeu o fluxo.

Mas essa é uma resposta pequena demais para uma pergunta grande.

A resposta estratégica é:

- errou o processo que não blindou a transferência de informação crítica;

- errou a operação que normalizou sobrecarga;

- errou a arquitetura tecnológica que não destacou risco conhecido;

- errou a governança que tolerou registros paralelos;

- errou a cultura que privilegia culpa sobre aprendizagem;

- errou a liderança que aceitou tudo isso como parte natural do hospital.

📌 Em outras palavras: o profissional executou a falha. O sistema a construiu.

E aqui está a frase que deveria incomodar conselhos, diretorias, gestores assistenciais e líderes de tecnologia:

⚠️ Se o seu hospital depende da atenção heroica de indivíduos para evitar erros previsíveis, então ele não é seguro. Ele é apenas sortudo.

9. Perguntas diretas que o seu hospital precisa enfrentar

Quem errou de verdade?

👉 O indivíduo visível ou a organização que permitiu que múltiplas fragilidades convergissem sobre o paciente?

Quantos erros ainda estão escondidos?

👉 Os notificados são apenas a superfície. O volume real inclui quase-erros, desvios compensados informalmente e riscos neutralizados por esforço humano invisível.

O seu hospital pune ou aprende?

👉 Se a primeira reação institucional é procurar culpados antes de mapear barreiras rompidas, a resposta provavelmente já existe.

A sua tecnologia protege ou apenas registra?

👉 Sistema que documenta depois do dano, mas não ajuda a evitá-lo antes, entrega pouco valor estratégico.

Seu prontuário é instrumento clínico ou arquivo digital?

👉 Se a equipe precisa caçar informação crítica em múltiplas telas, o problema não é adesão; é arquitetura.

Sua liderança entende segurança como agenda transversal?

👉 Segurança do paciente não é responsabilidade exclusiva da assistência. É pauta de operação, TI, dados, gente, governança e estratégia.

O hospital convive com improvisos crônicos?

👉 Quando o improviso é a engrenagem real da operação, o erro deixa de ser exceção. Vira possibilidade permanente.

10. Oportunidades reais de transformação

🚀 A boa notícia é que eventos dessa natureza não precisam ser tratados apenas como tragédia ou exposição. Eles podem se tornar ponto de inflexão institucional — desde que a resposta seja madura.

1. Redesenho de processos críticos

Mapear jornadas assistenciais de alto risco, identificar pontos de perda informacional, padronizar handoffs, estabelecer barreiras claras e reduzir dependência de memória humana.

2. Prontuário interoperável e orientado à decisão

Não basta integrar tecnicamente. É preciso tornar visíveis, acionáveis e contextuais as informações críticas. Alergias, reações adversas, contraindicações e alertas precisam aparecer com prioridade semântica real.

3. IA para suporte à decisão clínica e operacional

A IA pode atuar em:

- detecção de inconsistências prescricionais;

- alertas contextuais inteligentes;

- monitoramento de riscos assistenciais;

- análise preditiva de eventos adversos;

- priorização de revisão em fluxos críticos.

Mas atenção: IA boa não substitui governança ruim. Ela amplifica maturidade, não improviso.

4. Automação de processos críticos

Automatizar reconciliação medicamentosa, checagens de consistência, notificações de risco, fluxos de validação e rastreamento de eventos reduz variabilidade e libera capacidade cognitiva da equipe para decisões mais complexas.

5. Governança robusta de dados

Definir taxonomias, regras de captura, campos críticos obrigatórios, validação semântica, gestão de qualidade dos dados e interoperabilidade interna é parte da estratégia de segurança, não apenas da agenda de BI.

6. Cultura justa e aprendizado organizacional

Criar ambiente em que profissionais possam relatar falhas e quase-falhas sem medo irracional de punição é indispensável para antecipar riscos. Sem isso, o hospital perde sua maior fonte de inteligência operacional: quem vive o processo todos os dias.

7. Liderança preparada para ler sistemas, não apenas indivíduos

Diretores, gestores clínicos, operações e TI precisam compartilhar uma mesma gramática sobre erro, risco, processo, dado e transformação. Sem essa convergência, cada área enxerga só sua parte — e ninguém trata a causa inteira.

11. O que a liderança hospitalar precisa parar de fazer imediatamente

🛑 Há práticas que parecem gestão, mas na verdade perpetuam o problema.

Parar de tratar treinamento como solução universal

Treinamento é importante. Mas treinamento em cima de processo ruim é apenas uma forma educada de manter fragilidade com aparência de cuidado.

Parar de aceitar controles paralelos

Toda planilha informal, papel de apoio, grupo de mensagem improvisado ou caderno complementar revela insuficiência do sistema oficial.

Parar de celebrar resiliência humana como substituta de estrutura

Equipes que “dão conta” apesar do caos não provam que o hospital funciona. Provam que as pessoas estão compensando falhas institucionais.

Parar de separar TI da segurança do paciente

A tecnologia assistencial precisa entrar definitivamente no núcleo da estratégia clínica e operacional.

Parar de fazer investigação superficial de eventos

Sem análise de causa raiz de verdade, com profundidade processual, tecnológica, cultural e estratégica, a organização apenas teatraliza o aprendizado.

Parar de confundir controle com medo

Ambiente de medo reduz transparência, e transparência reduzida aumenta risco.

12. O desconforto executivo que realmente importa

📌 O ponto mais incômodo deste debate é que ele redistribui responsabilidade para cima. E nem toda liderança gosta disso.

É confortável imaginar que o erro mora no indivíduo porque isso preserva a estrutura de poder e absolve a arquitetura institucional. Mas, quando entendemos o erro como fenômeno sistêmico, a conversa muda de patamar.

Ela passa a exigir que o board responda perguntas difíceis:

- Como estamos desenhando nossos processos críticos?

- Nossa tecnologia protege ou atrapalha?

- Nossos dados são confiáveis, úteis e acionáveis?

- Nossa cultura favorece reporte ou silêncio?

- Nossas lideranças sabem analisar sistemas complexos?

- Estamos investindo em infraestrutura invisível com seriedade?

- Temos governança integrada entre assistência, operações e TI?

Se essas perguntas não estão na pauta executiva, então segurança do paciente ainda não entrou no lugar certo da agenda.

E isso tem consequências.

Porque hospitais não são julgados apenas pelos desfechos que conseguem produzir em condições ideais. Eles são julgados, cada vez mais, pela forma como desenham sistemas capazes de evitar danos previsíveis.

13. A analogia que o setor precisa entender de uma vez por todas

🏗️ Pense em um edifício com falha estrutural. Um dia, uma janela despenca. Alguém pode culpar o zelador, o técnico da manutenção ou o profissional que passou por ali antes. Mas, se o projeto, os materiais, a supervisão, a manutenção preventiva e a inspeção estavam comprometidos, então a queda da janela não é um incidente isolado. É a manifestação visível de uma estrutura defeituosa.

Na saúde, acontece o mesmo.

O evento adverso é a janela que caiu.

O profissional é o último a tocar a estrutura.

Mas a falha começou muito antes.

Essa compreensão muda o tipo de pergunta que o líder faz.

Em vez de “quem apertou o botão?”, ele passa a perguntar:

“quem desenhou um sistema em que apertar o botão errado era tão provável?”

Isso é gestão madura.

Isso é visão sistêmica.

Isso é liderança de verdade.

14. Frases que deveriam ficar na parede da diretoria, não apenas no auditório do congresso

🧠 Erro médico é muitas vezes um sintoma, não a doença.

🧠 Sistemas ruins produzem erros previsíveis.

🧠 Não existe segurança do paciente sem arquitetura de processos.

🧠 Tecnologia que não protege é apenas digitalização ornamental.

🧠 Cultura punitiva reduz transparência e amplia risco.

🧠 Dados invisíveis no fluxo assistencial são dados inúteis para a segurança.

🧠 Improviso recorrente é indicador de falha estrutural.

🧠 Hospital seguro não depende de heróis; depende de sistemas resilientes.

15. Conclusão: o problema não está nas pessoas. Está no sistema que elas operam.

🧭 O caso fictício deste artigo poderia ter ocorrido em muitas instituições. Não porque as equipes sejam incompetentes, mas porque boa parte da saúde ainda opera sobre uma contradição perigosa: exige excelência clínica em ambientes organizacionais que frequentemente sabotam a própria segurança que declaram defender.

O profissional da ponta não pode continuar sendo o amortecedor universal de processos ruins, tecnologia mal desenhada, comunicação falha, liderança ausente e cultura punitiva. Esse modelo está esgotado.

Quando um hospital insiste em personalizar o erro e despersonalizar o sistema, ele troca diagnóstico real por conforto narrativo. E conforto narrativo nunca salvou paciente.

A maturidade institucional começa quando se aceita uma verdade difícil:

o dano raramente nasce apenas no ato final. Ele é cultivado, silenciosamente, nas decisões anteriores que pareceram administrativas, tecnológicas ou culturais — mas que, no fim, eram profundamente clínicas.

Segurança do paciente não é uma disciplina periférica.

É uma consequência direta da qualidade do desenho organizacional.

E isso nos obriga a reconhecer algo essencial:

🛑 O problema não está apenas nas pessoas.

🛑 O problema está, muitas vezes, no sistema que elas operam.

🛑 E enquanto continuarmos culpando apenas o último elo, seguiremos preservando exatamente aquilo que produz o próximo erro.

Vamos falar sobre isso?

#VitorFerreira #TransformacaoDigital #Saude #SegurancaDoPaciente #InovacaoNaSaude #ErroSistemico #GestaoHospitalar #EraExponencial

Deixe um comentário